Card adapter bus cho máy chủ (Card HBA) là một bảng mạch và / hoặc Card IC cung cấp quá trình xử lý đầu vào / đầu ra (I / O) và kết nối vật lý giữa máy chủ và thiết bị lưu trữ. Vì Card HBA làm giảm gánh nặng cho bộ xử lý chủ trong các tác vụ lưu trữ và truy xuất dữ liệu, nên nó có thể cải thiện hiệu suất máy chủ. Card HBA và một hệ thống con đĩa được kết nối với nó đôi khi được gọi là kênh đĩa.

Định nghĩa chung về Card HBA – Card I/O kết nối bus I/O máy chủ và hệ thống bộ nhớ máy tính. Theo định nghĩa này, giống như card màn hình được kết nối với máy tính và bộ nhớ, NIC được kết nối với bus mạng và bộ nhớ, card SCSI-FC được kết nối với bus và bộ nhớ SCSI hoặc FC, chúng nên được coi là Card HBA. Card HBA bao gồm FC-Card HBA và iSCSI Card HBA và các Card HBA khác trong tương lai, nhưng Card HBA thường được sử dụng trong SCSI. Card (adapter) và NIC được sử dụng cho FC, và NIC cũng được sử dụng cho mạng Ethernet và Token Ring.

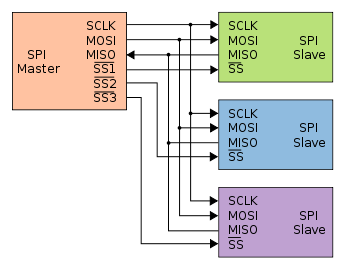

Chúng ta biết rằng một máy tính hầu hết được kết nối bởi hai bus (tất nhiên, tình hình thực tế sẽ khác nhau, ở đây chỉ nói đến tình huống phổ biến, đơn giản), một bus gọi là bus hệ thống, gọi khác là bus I / O. Bus hệ thống trên CPU, bộ nhớ, bộ nhớ đệm, v.v., bus I / O là thiết bị ngoại vi và hiện nay phổ biến nhất là bus PCI. Hai bus được kết nối bằng một chip hoặc mạch bắc cầu. Ví dụ như thành phố, có hai con đường chính, một đường thuộc khu hành chính, một đường thuộc khu thương mại, ở giữa có bùng binh, hai con đường chính nối với nhau, hệ thống xe buýt giống như chính. đường trong quận, và xe buýt I / O giống như trục đường chính trong khu thương mại. Đơn vị băng thông bus hệ thống và bus I / O là Gbyte cần ghi nhớ,

Mặc dù tốc độ bus I/O thấp hơn nhiều so với băng thông bus hệ thống, dù kết quả là Gbyte để đo lường và chúng ta biết tốc độ của các thiết bị ngoại vi, thường chỉ là vài trăm nghìn tỷ, thậm chí hàng chục k thôi, làm thế nào để điều phối công việc? Thật dễ dàng, chúng ta sẽ tổ chức các thiết bị ngoại vi, kết nối với bus I / O! Card HBA đề cập đến Máy chủ lưu trữ và I / O BUS trực tiếp là một bộ chuyển đổi, nhưng cũng giống như một thợ sửa ống nước thường nói “vượt qua kép”. Vai trò của Card HBA là đạt được giao thức kênh nội bộ PCI hoặc Sbus và chuyển đổi giữa giao thức Fibre Channel.

Tầm quan trọng của Card HBA

Trong hệ thống lưu trữ SAN ban đầu, máy chủ và việc truyền dữ liệu chuyển mạch là thông qua sợi quang, bởi vì máy chủ là lệnh SCSI cho thiết bị lưu trữ, không thể lấy giao thức IP mạng LAN thông thường, do đó, nhu cầu sử dụng FC truyền tải, vì vậy SAN này được gọi là FC-SAN, và sau đó xuất hiện trong gói giao thức IP SAN , có thể lấy mạng LAN thông thường, vì vậy được gọi là IP-SAN, điển hình nhất hiện nay là ISCSI phổ biến.

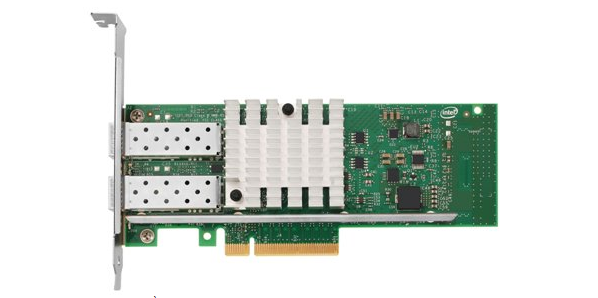

Hai phương pháp này cần thực hiện thao tác giải nén gói dữ liệu nặng, do đó hệ thống SAN hiệu suất cao yêu cầu một card mạng chuyên dùng để giải nén máy chủ để giảm gánh nặng cho bộ xử lý. NIC này được gọi là Card HBA, tất nhiên ngoài công việc giải nén, còn có thể cung cấp giao diện sợi quang (nếu cạc iSCSI Card HBA cung cấp giao diện RJ45 chung) cho kết nối chuyển mạch tương ứng; Về mặt vật lý, bạn có thể cắm Card HBA vào khe cắm PCI hoặc PCI như một card mạng, vì vậy việc sử dụng thiết bị này giống như một card mạng, và nhiều người nhầm lẫn nó với một NIC thông thường hoặc một card cáp quang thông thường. Tất nhiên, một số card iSCSI Card HBA có thể được sử dụng như một card mạng bình thường, nhưng nếu xét về giá cả thì rất không kinh tế.

Nguyên tắc của Card HBA

Giao thức truyền thông dữ liệu phổ biến giữa máy chủ và thiết bị lưu trữ là IDE, SCSI và Fibre Channel. Để đạt được giao tiếp giữa máy chủ và thiết bị lưu trữ, cần có cùng một giao thức truyền thông ở cả hai đầu của giao tiếp. Cạc điều khiển thường có sẵn trên thiết bị lưu trữ và bộ điều khiển triển khai một hoặc nhiều giao thức truyền thông cho phép chuyển đổi giữa các giao thức lưu trữ như IDE, SCSI hoặc Fibre Channel sang các giao thức hoạt động của thiết bị lưu trữ vật lý.

Giao thức truyền thông của máy chủ được thực hiện bởi một mạch tích hợp của cạc mở rộng hoặc bo mạch chủ, chịu trách nhiệm chuyển đổi giao thức bus máy chủ và giao thức lưu trữ IDE và SCSI. Ví dụ: trong PC, các tính năng của giao thức IDE có trên bo mạch chủ và bộ điều khiển đĩa của IDE có giao thức IDE. Do đó, đĩa IDE có thể được kết nối với đầu nối IDE trên PC.

Nếu đĩa chỉ hỗ trợ giao thức SCSI, thì không thể kết nối trực tiếp đĩa với PC. Bạn cần lắp cạc SCSI trên khe cắm mở rộng của PC và đĩa SCSI có thể được kết nối với cạc. Card SCSI cho phép chuyển đổi bus PC sang SCSI. Loại cạc SCSI này nhận ra chức năng là chức năng card adapter Bus máy chủ. Nếu đĩa chỉ hỗ trợ các giao thức Fibre Channel, thì giao thức Fibre Channel là bắt buộc trên máy chủ vì đặc tính tốc độ cao của Fibre Channel không được hỗ trợ bởi Bo mạch chủ chung và yêu cầu một card adapter bus máy chủ chuyên dụng. Sau khi máy chủ được cắm vào card adapter bus máy chủ, nó có thể được kết nối với đĩa hỗ trợ kênh sợi quang.

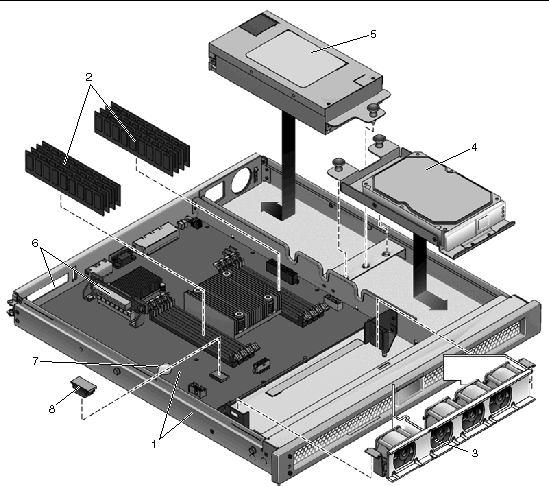

Cạc adapter bus chủ bên trong có một CPU nhỏ, một số bộ nhớ làm bộ nhớ đệm dữ liệu và kết nối kênh cáp quang và các thiết bị kết nối bus. Bộ xử lý trung tâm nhỏ này chịu trách nhiệm chuyển đổi các giao thức PCI và Fibre Channel. Nó còn có một số chức năng khác để khởi tạo cổng máy chủ kết nối với mạng Fibre Channel, hỗ trợ các giao thức lớp trên như mã hóa và giải mã TCP / IP, SCSI, 8B / 10B.

Mối quan hệ giữa cạc giao diện mạng cáp quang Cạc (NIC) và Card HBA

Do giao thức truyền dẫn khác nhau, card mạng có thể được chia thành ba loại, một là card Ethernet, loại còn lại là card mạng Fibre Channel và ba là card mạng iSCSI.

Card mạng Ethernet – Tên của Card Ethernet, giao thức truyền tải là giao thức IP, thường được kết nối với bộ chuyển mạch Ethernet thông qua cáp quang hoặc cáp xoắn đôi. Các loại giao diện được chia thành cổng quang và cổng điện. Cổng quang thường được truyền qua cáp quang , module giao diện thường là SFP (tốc độ truyền GB) và GBIC (1GB / s), giao diện tương ứng là SC, ST và LC. Loại giao diện thường được sử dụng hiện nay là RJ45, nó được sử dụng để kết nối với xoắn đôi, cũng có giao diện với cáp đồng trục, nhưng hiện nay nó được sử dụng ít hơn.

FC Card mạng – hay còn gọi chung là card mạng cáp quang, tên khoa học là Fiber Channel Card HBA. Giao thức truyền tải là một giao thức Kênh Sợi và thường được kết nối với một bộ chuyển Kênh Sợi thông qua cáp quang . Loại giao diện được chia thành cổng quang và cổng điện. Giao diện quang thường thông qua cáp quang để truyền dữ liệu, mô-đun giao diện thường là SFP (tốc độ truyền 2Gb / s) và GBIC (1Gb / s), giao diện tương ứng cho SC và LC. Loại giao diện của giao diện điện nói chung là chân DB9 hoặc HSSDC.

ISCSI Card mạng – Tên của iSCSI Card HBA, giao thức Transport iSCSI và kiểu giao diện giống như card Ethernet.

Chúng tôi nói “card mạng cáp quang” thường đề cập đến cạc FC Card HBA, cắm vào máy chủ, bộ nhớ ngoài với bộ chuyển mạch quang; và cạc Ethernet quang thường được gọi là “Card Ethernet quang” cũng được đưa vào máy chủ, nhưng nó bên ngoài là bộ chuyển mạch Ethernet với cổng quang.

Nguồn: https://netsystemvn.com/